Réponse rapide : Les Core Web Vitals sont trois métriques de performance web utilisées par Google comme signal de classement : LCP (chargement), CLS (stabilité visuelle) et INP (réactivité). Pour les optimiser, il faut viser LCP sous 2,5 s, CLS sous 0,1 et INP sous 200 ms. Ces seuils conditionnent l'accès au label "Good" dans PageSpeed Insights et influencent le référencement naturel en 2026.

- LCP sous 2,5 secondes : précharger les images hero, utiliser un CDN et un serveur rapide

- CLS sous 0,1 : définir des dimensions explicites pour images, vidéos et publicités

- INP sous 200 ms : réduire le travail JavaScript sur le thread principal

Qu'est-ce que les Core Web Vitals et pourquoi Google les mesure-t-il ?

Les Core Web Vitals sont un sous-ensemble de signaux de la Web Vitals Initiative de Google, introduits officiellement comme facteur de classement en 2021. Ils mesurent l'expérience utilisateur réelle sur trois dimensions : vitesse de chargement du contenu principal, stabilité visuelle de la page et réactivité aux interactions.

Google collecte ces données via le Chrome User Experience Report (CrUX), qui agrège des millions de sessions réelles d'utilisateurs Chrome. Ce n'est pas une simulation de laboratoire : les scores reflètent ce que vos visiteurs vivent réellement, sur leurs appareils et connexions, au 75e percentile de vos sessions.

En 2026, l'importance de ces métriques dépasse le simple classement organique. Les moteurs de recherche IA analysent également la qualité technique des sources avant de les citer dans leurs réponses générées. Un site lent ou instable envoie un signal négatif de fiabilité editoriale.

LCP (Largest Contentful Paint) : comment atteindre les 2,5 secondes

Le LCP mesure le temps nécessaire pour afficher l'élément de contenu le plus volumineux visible dans le viewport initial, qu'il s'agisse d'une image hero, d'un bloc de texte ou d'une vidéo. Un LCP inférieur à 2,5 secondes est classé "Good", entre 2,5 et 4 secondes "Needs Improvement", au-delà de 4 secondes "Poor".

La première action à mettre en place est le préchargement de l'image LCP avec la balise <link rel="preload">. Cette directive informe le navigateur de télécharger l'image en priorité, avant même que le CSS ou le JavaScript soient analysés. Sur les pages où l'image hero domine, ce seul changement peut réduire le LCP de 0,5 à 1,5 secondes.

L'hébergement joue un rôle déterminant. Un Time to First Byte (TTFB) supérieur à 600 ms pénalise mécaniquement le LCP, car le navigateur attend la réponse serveur avant de pouvoir commencer à rendre quoi que ce soit. Un CDN bien configuré, un cache serveur agressif et une infrastructure géographiquement proche des utilisateurs sont les leviers les plus efficaces à ce stade.

Le format des images conditionne également la vitesse de chargement. Adopter WebP ou AVIF plutôt que JPEG ou PNG réduit le poids des fichiers de 30 à 50 % à qualité visuelle équivalente. L'attribut fetchpriority="high" sur l'image LCP, disponible dans tous les navigateurs modernes, complète le dispositif.

CLS (Cumulative Layout Shift) : éliminer les décalages visuels inattendus

Le CLS quantifie l'instabilité visuelle d'une page en mesurant l'amplitude des déplacements inattendus d'éléments pendant ou après le chargement. Un score CLS inférieur à 0,1 est acceptable ; au-delà de 0,25, l'expérience utilisateur est jugée mauvaise par Google.

La cause la plus fréquente de CLS élevé est l'absence de dimensions explicites sur les images et vidéos. Quand le navigateur ne connaît pas la taille d'un média avant de le télécharger, il alloue zéro espace dans la mise en page, puis déplace tout le contenu environnant lorsque le fichier arrive. Définir systématiquement les attributs width et height sur chaque balise <img> suffit à éliminer ce comportement.

Les polices web génèrent également du CLS via le phénomène de Flash Of Unstyled Text (FOUT). Utiliser font-display: optional ou font-display: swap associé à un préchargement des fichiers de police réduit le décalage. La propriété CSS size-adjust permet en outre d'aligner la métrique de la police de substitution sur la police finale, minimisant l'écart visuel au moment du remplacement.

Les publicités, bannières et contenus embarqués de taille dynamique sont une autre source majeure de CLS. Réserver un espace fixe en CSS via min-height ou aspect-ratio avant l'injection du contenu publicitaire élimine le problème à la racine. La cartographie comportementale par heatmap permet par ailleurs d'identifier les zones où les décalages impactent le plus les interactions réelles des visiteurs.

INP (Interaction to Next Paint) : réduire la latence des interactions

INP remplace FID (First Input Delay) depuis mars 2024 et mesure la latence de toutes les interactions utilisateur sur la durée complète de la session : clics, appuis sur touches, tapotements. Le seuil "Good" est fixé à 200 ms maximum ; au-delà de 500 ms, la page est classée "Poor".

L'INP est déterminé par le thread principal du navigateur. Quand du JavaScript lourd monopolise ce thread, les interactions utilisateur s'accumulent en file d'attente et ne sont traitées qu'après la fin du bloc de code en cours. Découper les tâches longues (supérieures à 50 ms) via scheduler.yield() ou setTimeout(0) libère le thread régulièrement et maintient une réactivité perceptible.

Les frameworks JavaScript modernes comme React ou Vue génèrent parfois des arbres de composants complexes dont le rendu bloque le thread. L'usage de React Server Components ou d'une stratégie d'hydratation partielle (islands architecture) limite le JavaScript envoyé et exécuté côté client. L'objectif est de n'hydrater que les composants interactifs, pas l'intégralité de la page.

La gestion des événements influe aussi sur INP. Des écouteurs d'événements attachés à des sélecteurs trop larges (comme document ou body) déclenchent des calculs inutiles à chaque interaction. Déléguer les événements de manière ciblée et éviter les traitements synchrones coûteux dans les callbacks réduit mécaniquement la latence perçue. Les équipes qui mettent en place une supervision informatique en temps réel peuvent détecter les dégradations d'INP en production avant qu'elles n'affectent les scores CrUX.

Outils de mesure des Core Web Vitals en 2026

Mesurer les Core Web Vitals requiert de distinguer deux types de données : les données de laboratoire (simulation contrôlée) et les données de terrain (expériences réelles des utilisateurs). Google n'utilise que les données de terrain pour le classement, via le rapport CrUX.

| Outil | Type de données | Métriques couvertes | Usage principal |

|---|---|---|---|

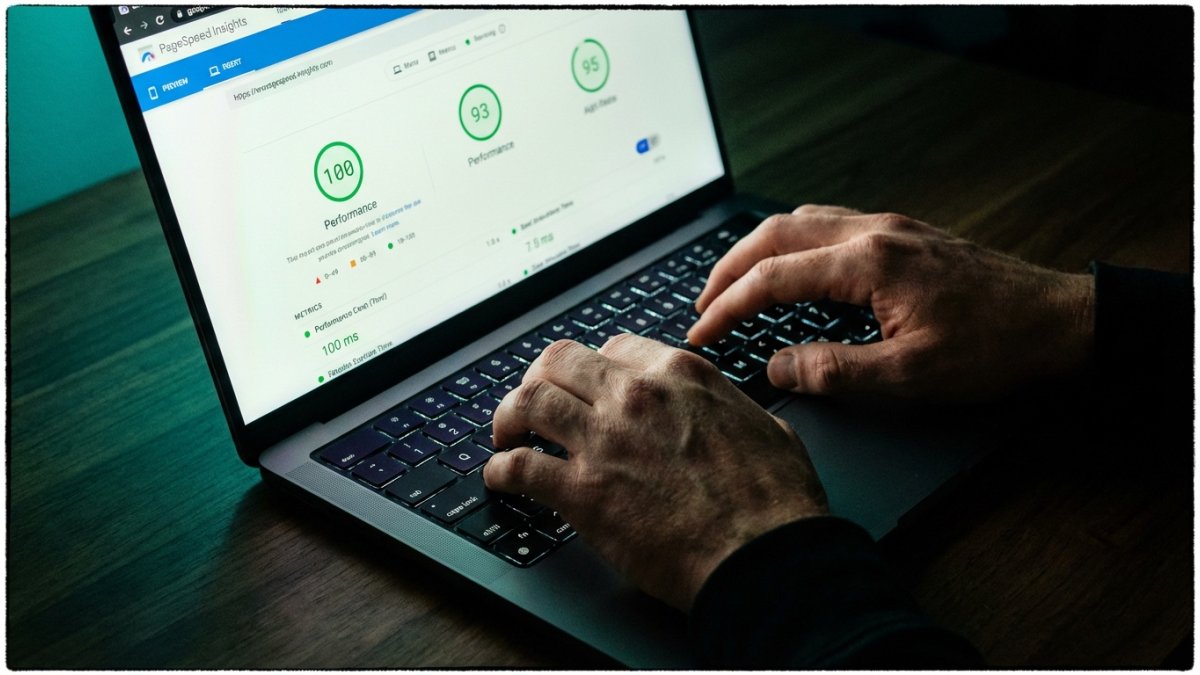

| PageSpeed Insights | Labo + Terrain | LCP, CLS, INP, TTFB | Audit rapide par URL |

| Google Search Console | Terrain (CrUX) | LCP, CLS, INP | Vue globale du site |

| Chrome DevTools | Labo | LCP, CLS, INP, TBT | Debug et profilage |

| web-vitals.js | Terrain (RUM) | LCP, CLS, INP, FCP, TTFB | Collecte custom en production |

| Lighthouse CI | Labo | Toutes métriques | Intégration CI/CD |

Google Search Console reste l'outil de référence pour suivre l'évolution des scores terrain sur l'ensemble du site. Le rapport "Expérience de la page" regroupe les URLs par statut (Good, Needs Improvement, Poor) et permet d'identifier les templates problématiques. Les données CrUX sont mises à jour mensuellement et reflètent les 28 derniers jours de trafic réel.

Pour un suivi continu en production, la librairie open-source web-vitals.js permet de collecter les métriques directement depuis les navigateurs des visiteurs et de les envoyer vers un outil d'analyse (Google Analytics 4, Datadog, InfluxDB). Cette approche Real User Monitoring (RUM) offre une granularité que les outils de laboratoire ne peuvent pas reproduire. Les tests d'acceptation fonctionnelle peuvent s'appuyer sur le recettage informatique pour inclure des seuils de performance dans les critères de validation de chaque déploiement.

Stratégie d'optimisation par type de site

Les priorités d'optimisation varient selon l'architecture du site. Un site e-commerce à fort trafic mobile souffrira en priorité d'un INP dégradé par des scripts tiers (chat, personnalisation, analytics), tandis qu'un blog éditorial sera davantage pénalisé par un LCP lent sur les images d'articles.

Pour les sites propulsés par WordPress, les gains les plus rapides passent par : un plugin de cache serveur (WP Rocket, LiteSpeed Cache), la compression des images en WebP via un outil automatisé, et le report du JavaScript non critique avec defer ou async. Ces ajustements permettent généralement de passer de scores rouges à verts en moins d'une semaine.

Les sites construits sur des frameworks JavaScript (Next.js, Nuxt, Astro) bénéficient d'un contrôle plus fin. Next.js 15 intègre nativement des optimisations LCP via son composant Image et le streaming HTML partiel via les React Server Components. Astro adopte une approche différente en générant du HTML statique par défaut et en n'envoyant du JavaScript que pour les îlots interactifs explicitement marqués. La réduction de l'empreinte numérique des sites, incluant leur consommation de ressources serveur, est détaillée dans le guide sur le numérique responsable et l'empreinte carbone.

Pour les sites à fort volume de scripts tiers (publicité, A/B testing, CRM), la façade de script tiers est une technique efficace : remplacer le script tiers par un composant statique qui ne charge le script réel qu'à l'interaction de l'utilisateur. Cette approche réduit l'INP et le TBT (Total Blocking Time) sans sacrifier les fonctionnalités. L'analyse de l'audience via des outils comme SparkToro pour l'intelligence d'audience aide à prioriser les optimisations selon les comportements réels des segments les plus importants.

Core Web Vitals et SEO en 2026 : ce qui a réellement changé

Le signal Page Experience, qui intègre les Core Web Vitals, représente un facteur de classement parmi des centaines d'autres. Google a confirmé que la pertinence du contenu prime toujours sur la performance technique : une page très pertinente avec un LCP de 3 secondes surclassera une page rapide mais peu pertinente. L'optimisation technique est un amplificateur, pas un substitut à la qualité éditoriale.

Ce qui a évolué en 2026, c'est le rôle des Core Web Vitals dans l'éligibilité aux AI Overviews de Google. Les sources citées dans les réponses IA générées tendent à être des pages techniquement propres : chargement rapide, pas de CLS, contenu accessible sans JavaScript. Un site avec des scores "Poor" sur les Core Web Vitals prend le risque d'être ignoré par les systèmes de sélection automatique des sources, indépendamment de la qualité de son contenu.

L'impact mobile reste sous-estimé par beaucoup d'équipes. CrUX pondère les données mobile et desktop selon la répartition réelle du trafic du site. Pour un site dont 70 % du trafic vient du mobile, un INP de 350 ms sur smartphone suffira à faire basculer le score global en "Needs Improvement", même si la version desktop est parfaite. Tester systématiquement sur des appareils d'entrée de gamme avec une connexion 4G simulée est une pratique indispensable.

Questions fréquentes sur les Core Web Vitals

Quelle est la différence entre FID et INP ?

FID (First Input Delay) mesurait uniquement le délai de la toute première interaction sur une page. INP (Interaction to Next Paint) mesure la latence de toutes les interactions pendant toute la session, au 75e percentile. INP est donc un indicateur plus complet et plus représentatif de la réactivité globale d'une page. Il a officiellement remplacé FID dans les Core Web Vitals en mars 2024.

Comment vérifier mes scores Core Web Vitals gratuitement ?

Plusieurs outils gratuits permettent de mesurer les Core Web Vitals. PageSpeed Insights (pagespeed.web.dev) fournit les données terrain CrUX et une analyse de laboratoire par URL. Google Search Console offre une vue d'ensemble du site dans le rapport "Expérience de la page". Chrome DevTools et l'extension Chrome Web Vitals permettent une mesure en direct lors de la navigation.

Les Core Web Vitals influencent-ils directement le classement Google ?

Oui, les Core Web Vitals sont un signal de classement officiel depuis 2021, intégré dans le système Page Experience. Leur poids relatif reste difficile à quantifier précisément car Google combine des centaines de signaux. En pratique, ils jouent un rôle de différenciateur entre pages de pertinence équivalente, et influencent également l'éligibilité aux enrichissements SERP et aux citations dans les AI Overviews.

Combien de temps faut-il pour voir l'impact des optimisations sur les scores CrUX ?

Les données CrUX reflètent les 28 derniers jours de trafic réel, mises à jour mensuellement. Après une optimisation significative, il faut généralement attendre 4 à 6 semaines pour observer un changement dans Google Search Console. Les données de laboratoire (PageSpeed Insights, Lighthouse) reflètent les changements immédiatement, mais ce ne sont pas ces données que Google utilise pour le classement.

Un bon score Core Web Vitals suffit-il pour améliorer son référencement ?

Non. Les Core Web Vitals améliorent l'expérience utilisateur et constituent un signal technique positif, mais la pertinence du contenu, l'autorité du domaine, les backlinks et la qualité éditoriale restent les facteurs dominants du classement Google. Un bon score Core Web Vitals est une condition nécessaire pour être compétitif, pas une garantie de positionnement.

Pourquoi mon score PageSpeed est bon mais mon CrUX est mauvais ?

PageSpeed Insights en mode laboratoire simule un chargement dans des conditions contrôlées (appareil Moto G Power, connexion 4G simulée, aucun script tiers chargé). Votre CrUX reflète la réalité de vos visiteurs : appareils variés, connexions instables, scripts tiers actifs, cache du navigateur. Les écarts sont fréquents, notamment sur l'INP que le laboratoire ne peut pas mesurer fidèlement sans interactions réelles.

Quel est l'impact du JavaScript tiers sur les Core Web Vitals ?

Les scripts tiers (chatbots, outils de personnalisation, pixels publicitaires, A/B testing) sont souvent la principale cause d'INP élevé et de TBT (Total Blocking Time) important. Ils s'exécutent sur le même thread principal que votre code et peuvent bloquer les interactions pendant plusieurs centaines de millisecondes. Auditer et différer les scripts non critiques, ou les charger via une façade lazy, est l'un des leviers les plus efficaces sur les sites à fort volume de tags.

Le CLS est-il mesuré après le chargement initial uniquement ?

Non. Depuis la version 2 de la métrique (2021), le CLS est mesuré sur la durée complète de la session, pas uniquement pendant le chargement. Les décalages provoqués par des animations CSS, des composants accordéon, des modales ou des publicités qui se chargent après l'interaction de l'utilisateur sont également comptabilisés. Seuls les décalages initiés par l'utilisateur (défilement intentionnel, clic sur un bouton) sont exclus du calcul.

Ce qu'il faut retenir pour optimiser vos Core Web Vitals en 2026

Les trois métriques Core Web Vitals ciblent des dimensions complémentaires de l'expérience : la vitesse perçue (LCP), la stabilité visuelle (CLS) et la réactivité (INP). Atteindre les seuils "Good" sur les trois nécessite une approche structurée, en commençant par un audit terrain via Search Console et PageSpeed Insights. Les gains les plus rapides viennent souvent du préchargement de l'image LCP, de la définition des dimensions des médias et du report des scripts tiers. Intégrer ces métriques dans le processus de déploiement, via des tests automatisés en CI/CD, est la seule façon de maintenir les scores dans le temps face aux évolutions du code et des contenus.